Les travailleurs chargés d’améliorer la production du chatbot Bard de Google disent qu’on leur a demandé de se concentrer sur le travail rapide au détriment de la qualité. Le barde génère parfois des informations inexactes simplement parce que les vérificateurs des faits n’ont pas assez de temps pour vérifier la sortie du programme, a déclaré l’un de ces travailleurs. enregistrer.

Les grands modèles de langage tels que Bard apprennent quels mots générer ensuite à partir d’une invite donnée en ingérant des montagnes de texte provenant de diverses sources, telles que le Web, des livres et des documents. Mais ces informations sont complexes et les chatbots intelligents qui prédisent les phrases ne peuvent pas distinguer les faits de la fiction. Ils font tout leur possible pour imiter la façon dont nous, les humains, faisons.

Dans l’espoir de rendre les grands modèles de langage comme Bard plus précis, des travailleurs de crowdsourcing sont embauchés pour évaluer l’exactitude des réponses du bot ; Ces commentaires sont ensuite renvoyés dans le pipeline afin que les futures réponses du bot soient de meilleure qualité. Google et d’autres mettent les humains dans la boucle pour augmenter les capacités apparentes des modèles entraînés.

Ed Stackhouse – un entrepreneur de longue date engagé par le fournisseur de services de données Appen, qui travaille pour le compte de Google pour améliorer Froid Allégations selon lesquelles les travailleurs n’ont pas eu suffisamment de temps pour analyser l’exactitude de la production du barde.

Ils doivent lire l’invite de saisie et les réponses du barde, rechercher sur Internet des informations pertinentes et rédiger des notes commentant la qualité du texte. « On ne peut vous accorder que deux minutes pour quelque chose qui vous prendra 15 minutes à vérifier », nous a-t-il dit. Cela n’augure rien de bon pour l’amélioration du chatbot.

Un exemple pourrait être de regarder un texte de présentation créé par Bard décrivant une entreprise spécifique. Il a dit : « Il faut vérifier qu’une entreprise a été créée à telle date, que l’entreprise a fait tel projet et que le PDG est tel ou tel. » Il y a plusieurs faits qui doivent être vérifiés, et il n’y a souvent pas assez de temps pour les vérifier à fond.

Stackhouse fait partie d’un groupe de contractuels qui tirent la sonnette d’alarme sur la façon dont leurs conditions de travail pourraient rendre Bard inexact et potentiellement dangereux. On pourrait demander à Bard : « Pouvez-vous me dire les effets secondaires d’une prescription particulière ? » Et je devrai parcourir et vérifier chacun [Bard listed]. Il a demandé: « Et si j’en manque un? » « Chaque réclamation et réponse que nous voyons dans notre environnement peut aller aux clients – aux utilisateurs finaux. »

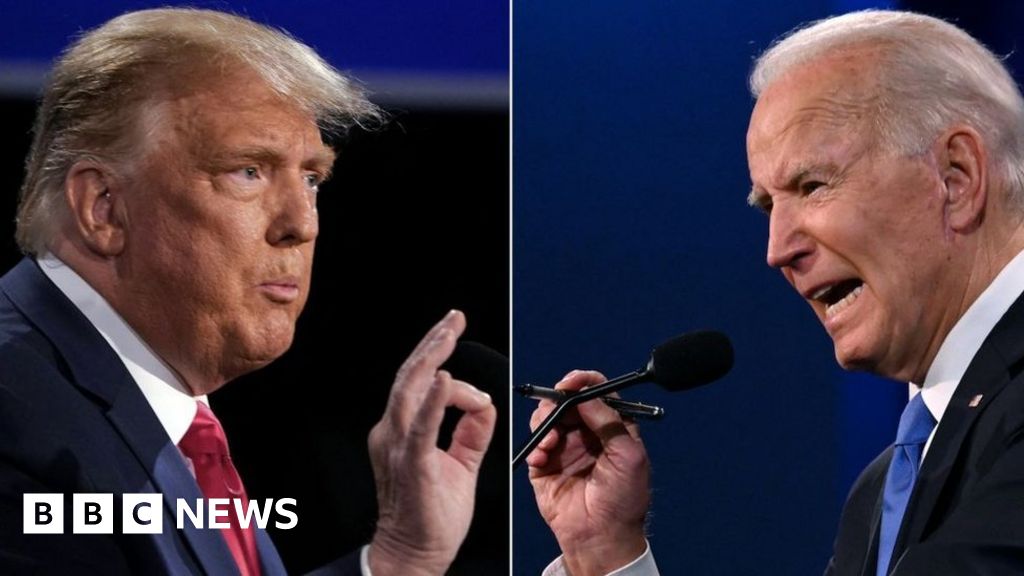

Et il ne s’agit pas seulement de problèmes médicaux – d’autres sujets peuvent également être risqués. Par exemple, la publication par Bard d’informations incorrectes sur les politiciens peut influencer l’opinion des gens sur les élections et saper la démocratie.

Les préoccupations de Stackhouse ne sont pas exagérées. Le ChatGPT d’OpenAI s’est considérablement amélioré accusé à tort Un maire australien a été reconnu coupable dans une affaire de corruption remontant au début des années 2000.

Si des travailleurs comme Stackhouse sont incapables de détecter et de corriger ces erreurs, l’IA continuera à répandre des mensonges. Les chatbots comme Bard pourraient alimenter un changement dans les fils narratifs de l’histoire ou de la culture humaine – des faits importants peuvent être effacés au fil du temps, a-t-il déclaré. « Le plus grand risque est qu’il puisse induire en erreur et avoir l’air si beau que les gens seront convaincus que l’IA a raison. »

Les entrepreneurs Appen sont pénalisés s’ils ne terminent pas les tâches dans le délai imparti, et les tentatives de persuader les gestionnaires de leur donner plus de temps pour évaluer les réponses du barde échouent. Stackhouse fait partie d’un groupe de six travailleurs qui disent avoir été licenciés pour avoir parlé, pour déposer une plainte pour pratique de travail déloyale auprès de l’organisme de surveillance du travail américain – National Labor Relations Board – The Washington Post signalé pour la première fois.

Les travailleurs accusent Eben et Google de licenciement illégal et d’ingérence dans leurs efforts pour se syndiquer. On leur aurait dit qu’ils avaient été licenciés en raison des conditions de travail. Stackhouse a déclaré qu’il avait trouvé cela difficile à croire, car Appen avait déjà envoyé des courriels aux travailleurs disant qu’il y avait eu une « augmentation significative des emplois disponibles » pour le projet Yukon – un programme visant à évaluer le texte pour les moteurs de recherche, qui comprend Bard.

Appen offrait aux entrepreneurs 81 $ supplémentaires en plus du salaire de base pour travailler 27 heures par semaine. On dit que les travailleurs sont généralement contraints de travailler 26 heures par semaine à 14,50 $ l’heure. L’entreprise affiche des offres d’emploi actives à la recherche d’évaluations sur les moteurs de recherche spécifiquement pour travailler sur le projet du Yukon. Eben n’a pas répondu à enregistrerDes questions.

Le groupe a également tenté de joindre Google, en contactant SVP Prabhakar Raghavan – qui dirige les activités de recherche du géant de la technologie – et a été ignoré.

La porte-parole de Google, Courtenay Mencini, n’a pas répondu aux préoccupations des travailleurs selon lesquelles Bard pourrait être nocif. « Comme nous l’avons partagé, Appen est responsable des conditions de travail de ses employés – y compris les salaires, les avantages sociaux, les changements de personnel et les tâches assignées. Nous respectons bien sûr le droit de ces travailleurs à adhérer à un syndicat ou à participer à une activité d’organisation, mais c’est une affaire entre les ouvriers et l’employeur Appen.

Cependant, Stackhouse a déclaré: « C’est leur produit. S’ils veulent un produit défectueux, c’est à eux. » ®

« Évangéliste amateur de zombies. Créateur incurable. Fier pionnier de Twitter. Amateur de nourriture. Internetaholic. Introverti hardcore. »

More Stories

Google mise sur la sécurité avec la prochaine version de son logiciel Android

Le nouveau modèle d’IA LearnLM de Google est axé sur l’éducation

Apple doit rattraper son retard en matière d’IA par rapport à Google et OpenAI